Еще в августе Meta представила свою мультимодальную модель перевода на основе искусственного интеллекта SeamlessM4T, поддерживающую перевод текста на 100 языков и речи на 36 языков. Благодаря обновленной архитектуре "v2" технологический гигант расширил возможности этого инструмента, чтобы сделать разговорный перевод более естественным и выразительным - ключевыми характеристиками для полноценного общения на разных языках.

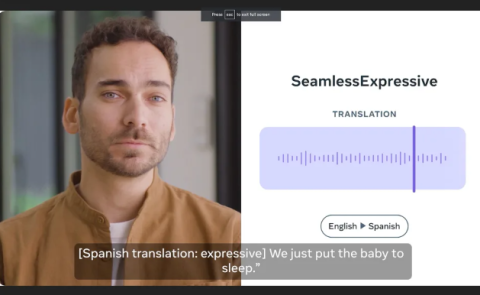

Первая из двух новых функций - "SeamlessExpressive", которая, как видно из названия, передает интонации исходной речи в перевод. К ним относятся высота и громкость голоса, эмоциональная окраска (волнение, грусть или шепот), скорость речи и паузы. Учитывая, что машинный перевод до сих пор звучал довольно роботизированно, это потенциально может изменить ситуацию, как в повседневном общении, так и в контент-производстве. Поддерживаемые языки: английский, испанский, немецкий, французский и китайский (на момент написания статьи итальянский отсутствовал в демо-версии).

Вторая функция - "SeamlessStreaming", запускающая перевод речи в режиме реального времени, пока говорящий продолжает говорить. Это позволяет собеседникам быстрее получать перевод. Задержка по-прежнему небольшая, около двух секунд, но хотя бы не приходится ждать, пока человек закончит предложение. По словам Meta, сложность заключается в том, что структура предложений в разных языках отличается. Поэтому пришлось разработать алгоритм анализа частичного аудиовхода, чтобы определить, достаточно ли контекста для генерации перевода или стоит продолжить прослушивание.

Последние разработки Meta в сфере "бесшовной коммуникации" выглядят впечатляюще, оставляя далеко позади инструменты мобильного перевода от таких компаний как Google и Samsung. Пока неизвестно, когда эти функции станут доступны широкой публике, но можно представить, как Meta встроит их в свои умные очки, сделав последние еще более полезными.